Смартфоны вскоре научатся понимать язык жестов с помощью нового алгоритма искусственного интеллекта, отслеживающего движения рук. Алгоритм, разработанный в Google AI Labs, позволит разным моделям смартфонов узнавать движения рук, соответствующие языку жестов.

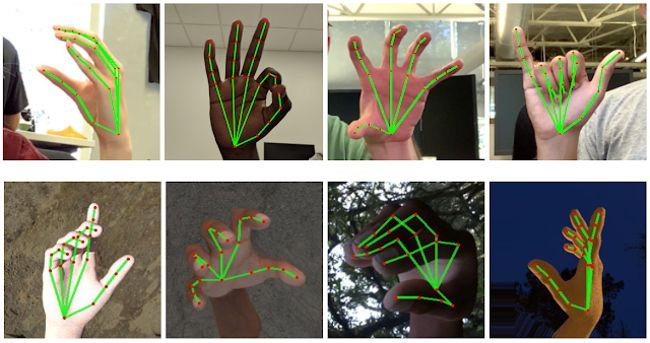

В компании объясняют, что использование алгоритма будет построено на платформе дополненной реальности. Отслеживание движений рук в реальном времени – сложная задача, поскольку действия человека часто непредсказуемы, руки могут закрывать друг друга, а изображение окажется недостаточно контрастным. С помощью машинного обучения алгоритм сможет понимать закономерности движений, запоминать и прогнозировать их. Программа установит 21 ключевую точку на трехмерной модели рук в каждом кадре.

Ранее похожие алгоритмы применялись на компьютерах, однако Google впервые предлагает снабдить такими возможностями смартфон. Проект подразумевает совместную работу трех моделей, детектора ладоней, детектора рук и алгоритма распознавания жестов. Вместо отслеживания руки целиком система будет фокусироваться только на ладони, считывая движения кисти – для максимально точного определения каждый палец будет анализироваться по отдельности. Распознав жест, алгоритм сопоставит его с движениями, уже записанными в системе – а комбинация будет интерпретирована как целое слово.

Команда Google опубликовала исходный код в открытом доступе, поэтому другие исследователи могут свободно использовать его в своей работе.

Комментарии

(0) Добавить комментарий