Возможности робота во многом определяют используемые датчики, поэтому исследователи из Стэнфордского университета и Университета Сан-Диего разработали новую камеру в формате 4D, которая значительно улучшает роботизированное зрение.

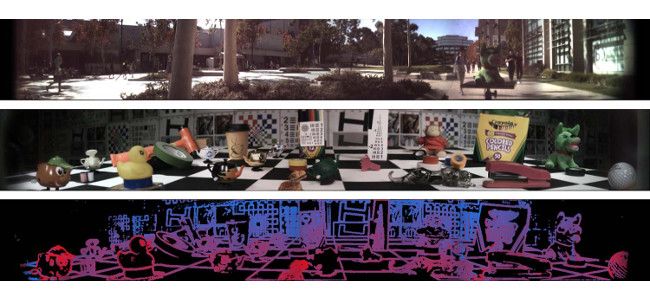

Названная первой однолинзовой широкоугольной камерой, новая система использует сферическую линзу и усовершенствованные алгоритмы для сбора информации в поле зрения 138 градусов, чтобы роботы могли не просто перемещаться, но и лучше воспринимать окружающую среду.

С момента появления современных роботов в 1970-х годах инженеры работают над проблемами машинного зрения. На протяжении многих лет были опробованы различные решения, такие как стереоскопические камеры, лазерная визуализация, цветовой анализ, подсчет пикселей и глубокое обучение. Теперь объединенная группа из Стенфорда и Сан-Диего создает новый тип камеры, используя сферические линзы, разработанные в процессе работы по программе DARPA SCENICC.

Эти линзы были созданы для охвата одной трети полной 360-градусной панорамы, получаемой с разрешением 125 мегапикселей на один видеокадр. В исходной версии видеокамера использовала волоконно-оптические пучки для преобразования сферических изображений в фокальные плоскости. Этот принцип работал, но был дорогостоящим.

В новой камере изображение распределяется по оптоволоконным пучкам в комплект линз, разработанных в Сан-Диего, с последующим применением цифровой обработки сигналов и технологии освещения, разработанных в Стэнфорде, что, по словам команды, дает камере «четвертое измерение».

Эта технология светового поля принимает поступающий в объектив двуосный свет и смешивает его с плоским (2D) изображением. Как и в случае с потребительскими камерами светового поля, подобным Lytro, это означает, что изображение теперь содержит гораздо больше информации о положении и направлении света и позволяет переориентировать изображения после съемки. Кроме того, это позволяет роботу видеть сквозь закрывающие обзор преграды, например, в дождь. Камера также способна улучшать изображения крупным планом, лучше определять расстояние до объекта и текстуру поверхности.

«Это может позволить различным типам ИИ понять, насколько далеко находятся объекты и перемещаются ли они, - говорит Гордон Ветштейн, профессор электротехники из Стэнфорда. - Эта система может быть полезна в любой ситуации, когда у вас ограниченное пространство, и вы хотите, чтобы компьютер воспринимал весь мир вокруг».

В настоящее время камера представляет собой концептуальное устройство, но исследователи полагают, что с совершенствованием технологии она поможет ориентироваться и перемещаться роботам, беспилотным летательным и наземным аппаратам, позволит системам расширенной виртуальной реальности воспроизводить целостное изображение. Следующим шагом будет использование более компактного прототипа в реальном роботе.

Комментарии

(0) Добавить комментарий