Любители и профессиональные исполнители музыки могут часами трудиться над своими видеоклипами для YouTube, чтобы понять, как лучше следует исполнять свои любимые композиции. Большим подспорьем для них было бы воспроизведения видео с возможностью выделить единственный инструмент, который нужно услышать.

В новом проекте лаборатории искусственного интеллекта и информатики(CSAIL) Массачусетского технологического института система ИИ с возможностью глубокого обучения может посмотреть видеозапись музыкального спектакля и изолировать звуки отдельных инструментов, сделать их громче или тише.

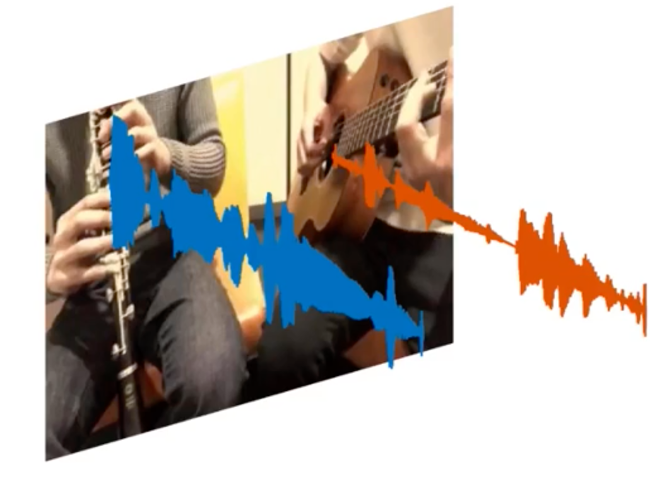

Эта система, которая является «самоконтролируемой», не требует какого-либо человеческого участия для того, чтобы разобраться в инструментах и звуках. Проведя более 60 часов обучения по видео, система PixelPlayer может просмотреть никогда еще не виденный музыкальный спектакль, определить конкретные инструменты на уровне пикселей и извлекать звуки, которые ассоциируются с этими инструментами.

Способность изменять громкость отдельных инструментов означает, что в будущем подобные системы потенциально могут помочь инженерам улучшить качество звука старых концертных съемок. Можно даже представить исполнителей, которые захотят услышать звучание определенной композиции с другими инструментами (т. е. можно быстро поменять электрическую гитару на акустическую).

PixelPlayer может идентифицировать звуки более 20 популярных инструментов. Ведущий автор исследования Хан Чжао говорит, что система сможет определить и многие другие инструменты после обучения, хотя она все еще может иметь проблемы с выявлением подклассов инструментов (например, альт саксофон и тенор).

Система сначала находит области изображения, которые связаны с воспроизводимыми звуками, а затем отсортировывает входные звуки в набор компонентов, которые представляют звук от каждого пикселя.

«Мы ожидали, что в лучшем случае сможем распознать, какие звуки воспроизводят отдельные инструменты, - говорит Чжао, аспирант CSAIL. - Мы были удивлены, что смогли на самом деле пространственно найти инструменты на уровне пикселей».

PixelPlayer использует методы глубокого обучения — это означает, что он находит закономерности в данных, используя нейронные сети, которые прошли обучение на имеющихся видеозаписях. В частности, одна нейронная сеть анализирует видеоряд клипа, другая анализирует звук, а третья является «синтезатором», ассоциирующим определенные пиксели с конкретными звуковыми волнами, чтобы разделить разные звуки.

Чжао говорит, что такая система, как PixelPlayer, может использоваться даже для роботов, чтобы лучше распознавать окружающие звуки и объекты, например, животных или транспорт.

Комментарии

(0) Добавить комментарий